Pourquoi les entreprises n’exploitent qu’une fraction de leurs données produit

Dans la plupart des entreprises, les données produit sont devenues un actif stratégique central. Elles structurent l’ensemble des activités opérationnelles : marketing, commerce, e-commerce, logistique et relation client.

Pourtant, malgré leur importance, ces données restent difficilement exploitables.

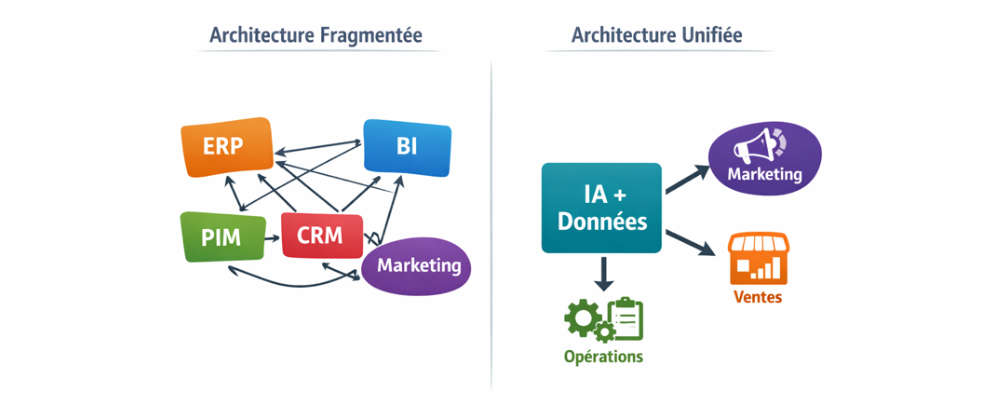

Elles sont réparties entre plusieurs systèmes — ERP, PIM, CRM, outils de Business Intelligence ou plateformes marketing — ce qui crée une fragmentation structurelle. Les équipes passent alors une grande partie de leur temps à chercher l’information, la consolider et l’interpréter, plutôt qu’à prendre des décisions.

Ce décalage est aujourd’hui critique : les entreprises disposent d’un volume de données considérable, mais n’en exploitent qu’une partie limitée, alors même que ces données pourraient directement améliorer leurs ventes, leurs marges et leur efficacité opérationnelle.

Ce que l’intelligence artificielle change concrètement

L’intelligence artificielle introduit une rupture dans la manière d’exploiter les données.

Elle permet de passer d’une logique d’analyse complexe, souvent réservée à des experts, à une logique d’accès direct à l’information et à la décision. Les équipes peuvent désormais interroger les données en langage naturel, obtenir des réponses immédiates et générer des actions concrètes.

Concrètement, cela signifie qu’un commercial peut identifier rapidement le bon produit, qu’un vendeur peut proposer une alternative pertinente en temps réel, ou qu’une équipe marketing peut activer des campagnes basées sur des données fiables et à jour.

Cette évolution ne se limite pas à un gain de productivité. Elle transforme la capacité des organisations à agir plus vite, à mieux recommander et à optimiser leurs performances commerciales.

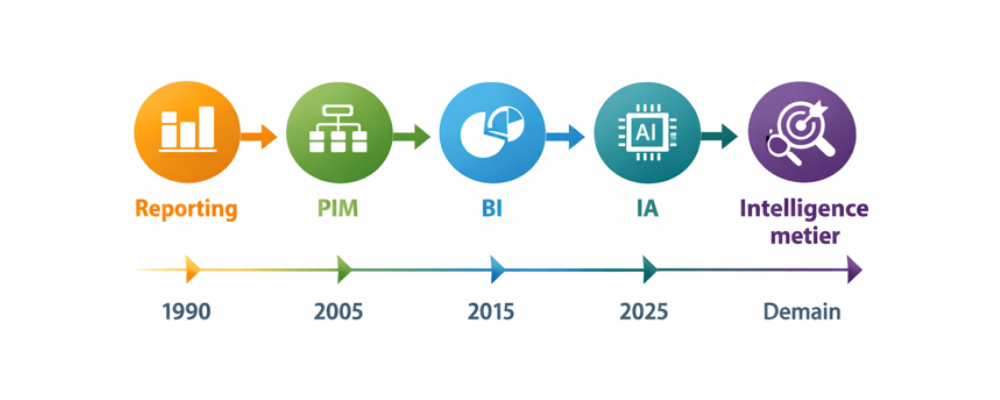

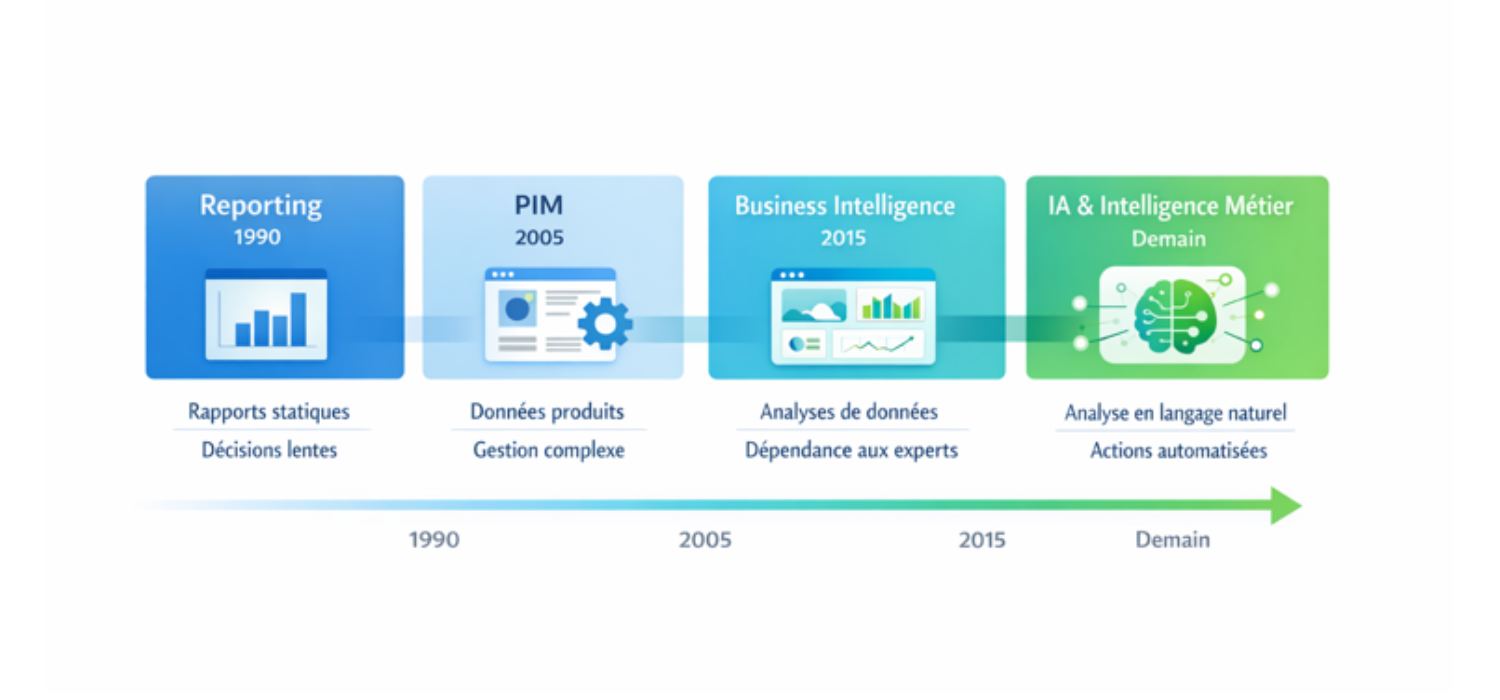

L’évolution des systèmes d’information : du reporting à l’intelligence métier

Pour comprendre cette transformation, il est essentiel de replacer l’évolution actuelle dans une perspective plus large.

L’ère du reporting

Dans les années 90 et 2000, les entreprises commencent à exploiter leurs données via des outils de reporting. Les informations sont extraites des bases de données pour produire des rapports, qui sont ensuite interprétés par les équipes.

Le modèle est linéaire : la donnée alimente le rapport, qui alimente la décision.

Le PIM : structurer les données produit

Avec l’essor du e-commerce, la complexité des catalogues produits augmente fortement. Les systèmes de Product Information Management (PIM) permettent alors de structurer les données, de centraliser les informations et de les diffuser vers les différents canaux.

Ces outils jouent un rôle essentiel, mais restent centrés sur la gestion de la donnée, et non sur son exploitation.

La Business Intelligence : analyser les performances

Dans les années 2010, la Business Intelligence démocratise l’analyse des données grâce à des outils comme Power BI ou Tableau. Les entreprises peuvent désormais visualiser leurs performances et explorer leurs données.

Cependant, cette approche présente une limite importante : elle reste dépendante d’experts et nécessite du temps pour produire des analyses exploitables.

Le problème actuel : une architecture data fragmentée

Aujourd’hui, les systèmes d’information sont constitués d’un empilement d’outils spécialisés, chacun répondant à un besoin spécifique.

Cette architecture crée des silos qui compliquent l’accès à l’information et ralentissent la prise de décision. Les équipes métier, qu’elles soient commerciales, marketing ou opérationnelles, dépendent encore fortement des équipes techniques pour accéder à des analyses pourtant essentielles à leur activité.

Cette complexité structurelle freine directement la performance des organisations.

La révolution technologique qui change la donne

Plusieurs évolutions majeures rendent aujourd’hui possible un nouveau modèle d’exploitation des données.

L’augmentation des volumes de données, liée au développement du e-commerce et des outils digitaux, a atteint un niveau qui dépasse les capacités d’analyse humaine traditionnelle.

Parallèlement, les infrastructures technologiques ont considérablement évolué. Le cloud computing, les GPU et les architectures distribuées permettent désormais de traiter ces données à grande échelle et en temps quasi réel.

Enfin, de nouvelles structures de données apparaissent. Les bases vectorielles permettent une recherche sémantique et une interaction naturelle avec les modèles d’intelligence artificielle. Les bases de graphes, quant à elles, offrent une modélisation plus fine des relations entre les données.

Ces évolutions combinées ouvrent la voie à une exploitation beaucoup plus intelligente et accessible des données.

Le changement clé : interroger les données en langage naturel

Le changement le plus structurant réside dans la manière dont les utilisateurs accèdent à l’information.

Là où les systèmes traditionnels nécessitaient des outils spécialisés et des compétences techniques, l’intelligence artificielle permet désormais d’interroger directement les données.

Un utilisateur peut poser une question simple et obtenir une réponse immédiatement exploitable. Cette capacité transforme profondément le rapport à la donnée, qui devient accessible à l’ensemble des équipes.

L’analyse n’est plus une étape intermédiaire complexe : elle devient une fonction intégrée au quotidien des métiers.

Yumint et LÉON : une plateforme d’intelligence métier unifiée

C’est dans ce contexte que Yumint développe LÉON, une plateforme d’intelligence métier conçue pour connecter les données, les analyses et les actions.

L’objectif est clair : transformer les données en décisions directement exploitables par les équipes.

La plateforme s’appuie sur une architecture combinant données métier, objets produits, bases vectorielles et intelligence artificielle. Elle permet de réunir dans un même environnement des fonctions jusqu’ici séparées.

Les données produit sont centralisées et rendues accessibles de manière intuitive. L’analyse commerciale devient instantanée et compréhensible par tous. Les actions opérationnelles sont directement connectées aux insights générés.

L’entreprise passe ainsi d’une logique d’analyse à une logique d’exécution.

Une nouvelle architecture pour l’entreprise data-driven

Historiquement, les systèmes d’information reposaient sur des modèles complexes, basés sur des bases relationnelles, des requêtes et des interfaces spécialisées.

Avec l’émergence de l’intelligence artificielle, un nouveau paradigme apparaît. L’intelligence n’est plus codée dans les systèmes, mais portée par les modèles capables de comprendre et d’analyser les données.

Ce changement simplifie profondément l’architecture et rend l’information accessible à un plus grand nombre d’utilisateurs.

Pourquoi les DSI et directeurs marketing doivent s’y intéresser maintenant

Cette transformation a un impact direct sur les fonctions clés de l’entreprise.

Pour les directions des systèmes d’information, elle permet de simplifier l’architecture, de réduire la dépendance aux outils spécialisés et d’accélérer l’accès aux données.

Pour les directions marketing et commerciales, elle offre la possibilité d’exploiter pleinement les données produit, d’optimiser les campagnes et de prendre des décisions plus rapidement.

Les entreprises qui s’engagent dans cette transformation disposent d’un avantage concurrentiel réel.

Conclusion : vers une nouvelle génération de systèmes d’entreprise

Nous assistons aujourd’hui à une convergence technologique majeure entre données, intelligence artificielle et systèmes métiers.

Cette convergence permet de dépasser les limites des outils traditionnels et d’ouvrir la voie à une nouvelle génération de plateformes capables de transformer les données en intelligence métier directement actionnable.

Dans ce contexte, la question n’est plus de savoir si les entreprises disposent de données, mais si elles sont capables de les exploiter efficacement.

C’est précisément l’ambition de Yumint : permettre aux organisations de transformer leurs données en décisions.